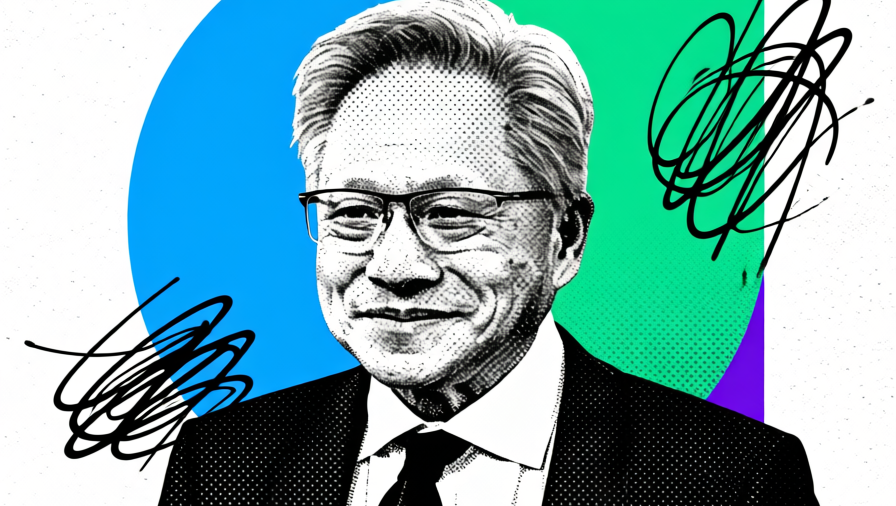

黄仁勋:HBM产能,有多少要多少

"我们需要行业能生产的所有HBM产能。" 在全球AI军备竞赛中,这位芯片教父罕见地公开承认了一个现实——HBM内存,已经成为比GPU更稀缺的资源。

---

产能到底有多缺?

当地时间3月16日,黄仁勋在GTC 2026开发者大会上正式发布了Groq 3 LPU——一款专门用于AI推理的新型芯片。但整场主题演讲中,最让业界关注的不是这款新产品,而是一段关于内存的表态。

> "We need as much HBM capacity as the industry can produce."

> (我们需要行业能生产的所有HBM产能。)

这不是黄仁勋第一次谈论HBM短缺。在此前后的多次财报电话会议上,他反复强调:"HBM是当前AI基础设施最受限的部分。"

一位接近NVIDIA供应链的人士透露,目前HBM的供应量只能满足其需求的约60%,缺口持续存在。

---

HBM为什么这么重要?

要理解HBM的战略价值,先要明白它是什么。

HBM(High Bandwidth Memory,高带宽内存)是一种垂直堆叠的DRAM技术。与传统GDDR内存相比,HBM能够提供数倍的带宽,同时功耗更低。对于AI计算来说,带宽直接决定了数据能否快速传输到GPU进行运算。

"你可以把GPU想象成一个超级工厂,"一位半导体行业分析师向本刊解释,"HBM就是工厂的仓库通道。通道越宽,原料(数据)进出越快,工厂的效率才能越高。"

为什么AI需要它?

大语言模型的推理过程需要频繁访问海量参数。以一个1000亿参数的模型为例,每次生成一个token,都需要从内存中读取数百亿字节的数据。HBM提供的超高速数据传输,能够大幅降低"内存墙"瓶颈,让GPU算力得到充分发挥。

"没有足够的HBM,再强的GPU也只能空转,"上述分析师补充道。

---

一个被产能卡住的万亿帝国

NVIDIA最新财报显示,其数据中心业务收入已达184亿美元,同比增长409%。毛利率高达75%——这是一个让所有硬件厂商羡慕的数字。

但HBM供应短缺正在成为甜蜜的负担。

据行业估算,HBM在NVIDIA高端GPU的成本中占比已达25%-30%。这意味着,每卖出一片价值数万美元的GPU,NVIDIA需要预留近1万美元采购HBM。

"我们正在与供应商紧密合作,尽可能增加HBM供应,"黄仁勋在财报电话会上表示。但他也承认,"至少在未来一到两年内,供应紧张将持续存在。"

这种紧缺直接影响了GPU的交付周期。有经销商透露,目前H100的等待周期仍需3-6个月,而中国市场特供的H20芯片同样面临供不应求。

---

抢产能的三大巨头

全球HBM市场呈现"两强一弱"的格局:

| 厂商 | 市场份额 | 技术进度 | 备注 |

|------|---------|---------|------|

| SK海力士 | ~50% | HBM3E量产 | 独家供应NVIDIA H100/H200 |

| 三星电子 | ~40% | HBM3E爬坡 | 积极争取NVIDIA认证 |

| 美光科技 | ~10% | HBM3E送样 | 正在追赶 |

SK海力士目前是NVIDIA最重要的HBM供应商。其为H100/H200量身定制的HBM3E颗粒已实现稳定供货,并正在建设新的晶圆厂扩产。

三星同样在加速追赶。3月16日,黄仁勋在GTC 2026上罕见地公开感谢三星:"我要感谢三星电子生产LPU芯片。三星目前正在尽可能多地生产。"

这番表态被业界解读为NVIDIA正在寻求HBM供应的"备胎方案"——减少对单一供应商的依赖。

---

另一个选项:SRAM会是替代品吗?

HBM的短缺催生了替代技术的讨论。在GTC 2026上,NVIDIA发布的Groq 3 LPU采用了SRAM作为内存方案。

技术对比显示:

- **SRAM带宽**:22-150 TB/s,是HBM的**7-45倍**

- **SRAM容量**:仅约500MB,是HBM4(288GB)的**1/500**

"SRAM就像一个超高速但容量极小的仓库,"上述分析师解释,"适合处理需要快速访问但数据量不大的任务,比如推理的一部分计算。但要运行万亿参数模型,必须用HBM。"

NVIDIA的策略是将Groq 3 LPX机架与Vera Rubin GPU平台结合使用——LPU处理需要高带宽的feed-forward网络计算,GPU处理需要大容量存储的attention机制。

这种"异构计算"方案能否缓解HBM压力,业界仍在观察。

---

市场预测:短缺将持续多久?

| 时间 | HBM市场规 | 供需状态 |

|------|-----------|---------|

| 2024年 | 约25亿美元 | 严重短缺 |

| 2025年 | 约50亿美元 | 轻微改善 |

| 2027年 | 预计超100亿美元 | 逐步平衡 |

多位行业分析师预计,HBM供应紧张至少将持续到2027年。SK海力士和三星的新增产能预计在2026年下半年陆续释放,但可能仍无法完全满足需求。

---

行业启示

1. 供应链为王:在AI时代,掌握关键零部件产能比设计芯片更重要。黄仁勋亲自站台要产能,说明了这一点。

2. 垂直整合优势:三星同时具备芯片设计和内存制造能力,正在成为NVIDIA不可或缺的合作对象。

3. 技术没有银弹:SRAM带宽更高,但容量短板决定它无法完全替代HBM。异构计算是现实选择。

4. 中国市场的特殊性:受出口管制影响,中国企业只能获得性能受限的特供芯片,HBM供应更加紧张。

---

结语

黄仁勋章的"有多少要多少",背后是整个AI产业的结构性瓶颈。当算力成为新石油,内存就成了卡住脖子那双看不见的手。

对于NVIDIA而言,成也HBM,困也HBM。这场关于产能的竞速,才刚刚开始。

---

*本文参考了The Lec、Reuters、NVIDIA财报电话会议、SK海力士/三星官方披露等信息。*